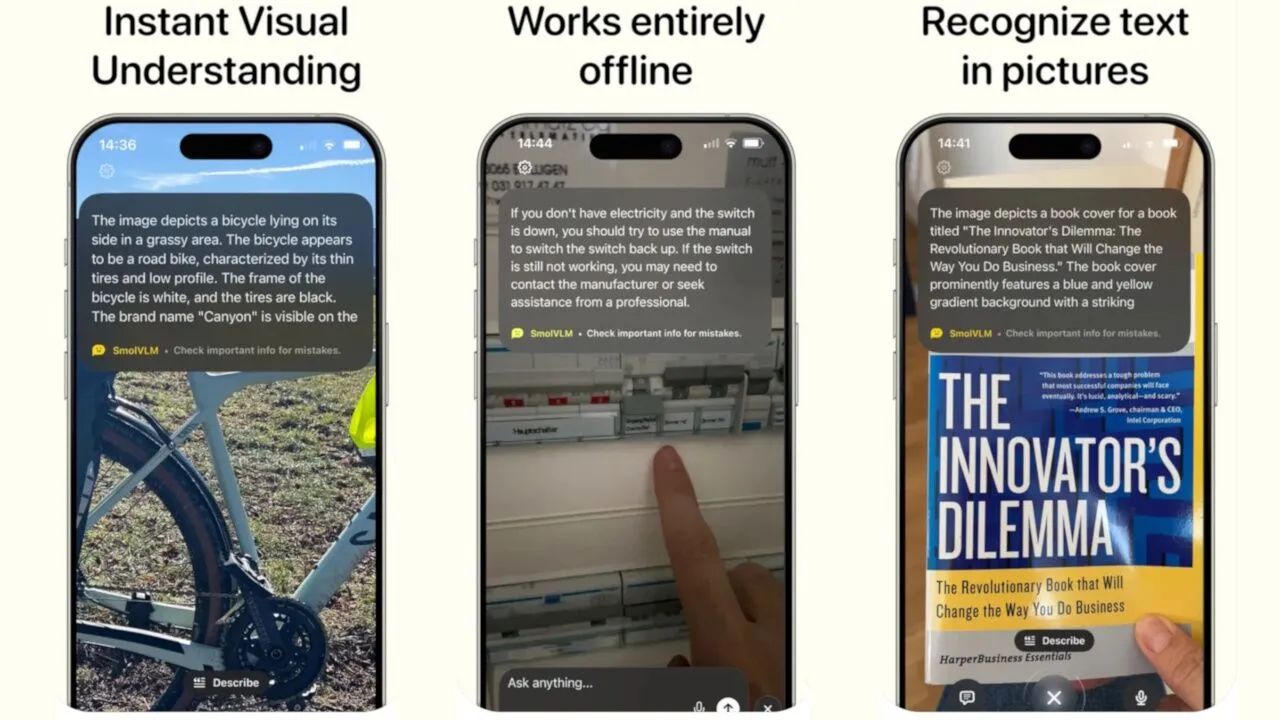

3 月 20 日,Hugging Face 推出了全新的 iOS 应用 HuggingSnap,这一创新应用为用户带来了前所未有的 AI 体验。与传统依赖云端服务器的 AI 应用不同,HuggingSnap 可以让用户在本地设备上直接要求 AI 生成视觉描述,无需将数据上传至云端,从而在根本上保障了用户的隐私安全。

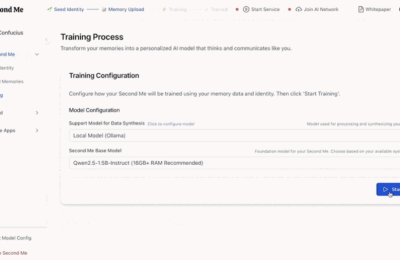

该应用的核心是轻量级多模态模型 smolVLM2,其参数规模介于 2.56 亿至 22 亿之间。这一模型经过精心设计,能够在本地设备上完成所有计算任务。smolVLM2 不仅专为移动设备优化,还能够高效处理图文任务,例如图像和视频分析等。尽管其准确率相较于云端的大模型(如 GPT-4o、Gemini)略显不足,但在移动设备上的表现已经相当出色。

smolVLM2 提供了不同参数规模的模型以满足用户多样化的需求。小型模型(2.56 亿参数)适合处理一些基础任务,例如简单的图像识别等;而大型模型(22 亿参数)则能够提供更为精准的解析,适用于复杂场景的分析。不过,使用大型模型可能会导致设备发热和耗电增加,用户可以根据自身需求和设备状况进行选择。

借助 HuggingSnap,用户可以即时获取复杂场景的详细描述,例如街景解析,这对于旅行者来说无疑是一个巨大的便利。此外,该应用还能够识别多语言文字,帮助用户在旅行中轻松翻译路牌等信息。更值得一提的是,HuggingSnap 还可以辅助视障人士独立导航,为他们提供更加便捷的生活体验。

Hugging Face 在开发 HuggingSnap 时,始终将“隐私设计优先”作为核心理念。公司明确表示,用户的数据仅存储于本地设备,不会与任何第三方共享。这一隐私保护措施让用户可以放心使用该应用,无需担心个人数据泄露的风险。