各位看官,今天必须得好好跟大家聊聊一款横空出世的开源实时目标检测模型——RF-DETR。这可是Roboflow团队倾力打造的杰作,堪称实时识别领域的“新晋王者”,简直不要太厉害哦!

是不是还在为YOLO系列模型速度不够快,精度差那么一点点而烦恼?别急,RF-DETR来拯救你啦!它一登场,就瞄准了实时识别领域的巅峰位置,并且大方地开源了。这意味着啥呢?意味着你可以免费把它领回家,还能像变魔术一样,随心所欲地“魔改”,打造出属于自己的专属“火眼金睛”,是不是很酷?

想象一下,如果你的智能监控系统像一位经验丰富的老侦探,能在视频流中瞬间锁定每一个关键物体,而且速度快得惊人,那得有多爽啊!RF-DETR就是这么一个高效的“侦探”。它不仅速度能和以往的实时模型一较高下,甚至还能超越它们,精度更是实现了质的飞跃。

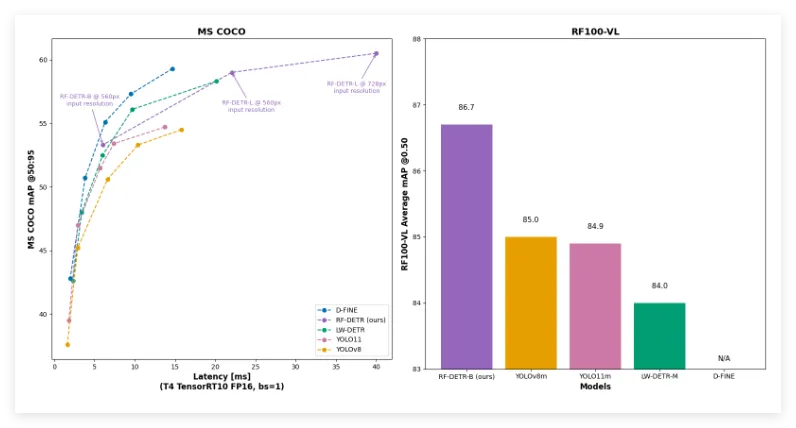

官方数据显示,RF-DETR是首个在COCO数据集上实现超过60%平均精度均值(mAP)的实时模型。COCO数据集可是计算机视觉界的“珠穆朗玛峰”啊,能在这么权威的数据集上取得如此优异的成绩,RF-DETR的实力那是杠杠的!

更厉害的是,RF-DETR在保证高精度的同时,速度一点儿都不慢。它在GPU上实现了超低的延迟,让实时识别真正落地,不再是遥不可及的梦想。这对于那些对响应速度要求极高的应用场景,比如自动驾驶、工业质检、智能安防等,简直就是一场及时雨。试想一下,当你的机器人像闪电一样快速识别并抓取目标物体时,效率岂不是蹭蹭往上涨?

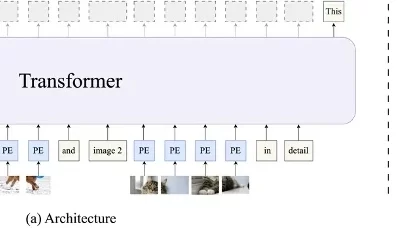

以前,基于CNN的YOLO系列模型在实时目标检测领域可是“一霸”,但如今,技术在不断进步,RF-DETR作为DETR(Detection Transformer)家族的一员,采用了基于Transformer的架构。这种架构有什么好处呢?它能够更好地进行全局信息建模,在复杂场景下也能实现更高的识别精度。

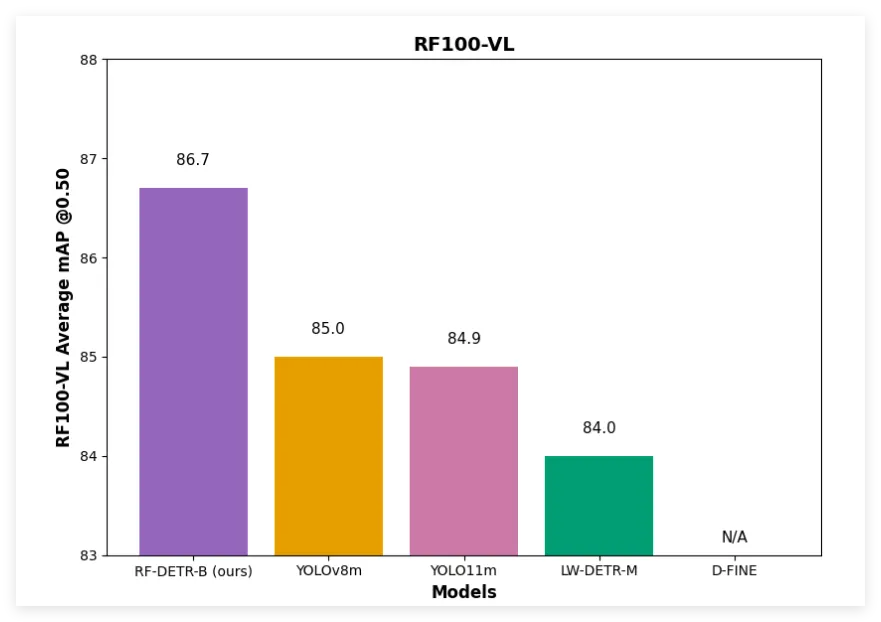

与YOLO模型相比,YOLO模型预测后还需要进行非极大值抑制(NMS)来筛选边界框,而DETR架构则省略了这一步,这在一定程度上提高了整体的运行效率。Roboflow团队在评测时,也考虑到了NMS带来的延迟,用“总延迟”这个概念来公平比较不同模型的性能。结果如何呢?RF-DETR在速度和精度上都表现得无可挑剔,在COCO数据集上相对于YOLO模型,那就是妥妥的帕累托最优。

不过,RF-DETR并没有完全摒弃CNN的优点。其实,很多优秀的计算机视觉方法,包括一些先进的DETR变体,都巧妙地融合了CNN和Transformer的优势。RF-DETR就是通过结合LW-DETR与预训练的DINOv2骨干网络,实现了超棒的性能和强大的领域适应性。这意味着什么呢?不管你的应用场景是常见的物体识别,还是更专业的领域,比如航空航天图像、工业环境、自然风光等,RF-DETR都有望大放异彩。

最让人兴奋的是,RF-DETR开源啦!它遵循Apache2.0许可协议,开发者可以自由地使用、修改,甚至将其应用到商业项目中,完全不用担心版权问题。Roboflow团队不仅放出了模型代码,还贴心地提供了Colab Notebook,手把手教你如何在自定义数据集上进行微调(fine - tuning)。未来,Roboflow平台还会提供更便捷的RF-DETR模型训练和部署支持。

目前,Roboflow团队已经推出了RF-DETR - base(2900万参数)和RF - DETR - large(1.28亿参数)两种模型尺寸,能够满足不同算力需求的应用场景。更有趣的是,RF - DETR还支持多分辨率训练,这意味着你在运行时可以灵活调整模型的分辨率,在精度和延迟之间找到最佳平衡点。家人们,还在等什么呢?赶紧试试RF - DETR吧!