8月17日,科技界传来重磅消息,英伟达携手Meta公司共同推出了一款全新的AI模型——Llama-3.1-Minitron 4B。这款模型以其精巧的构造和强大的性能,成为业界关注的焦点。它通过采用结构化权重剪枝和知识提炼等前沿技术,成功实现了从8B到4B的参数压缩,打造出了一个“小而强悍”的AI模型。

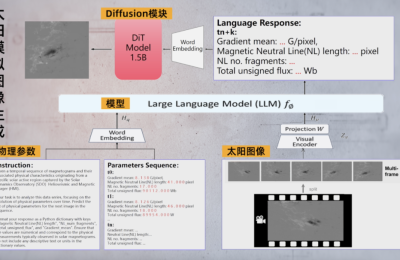

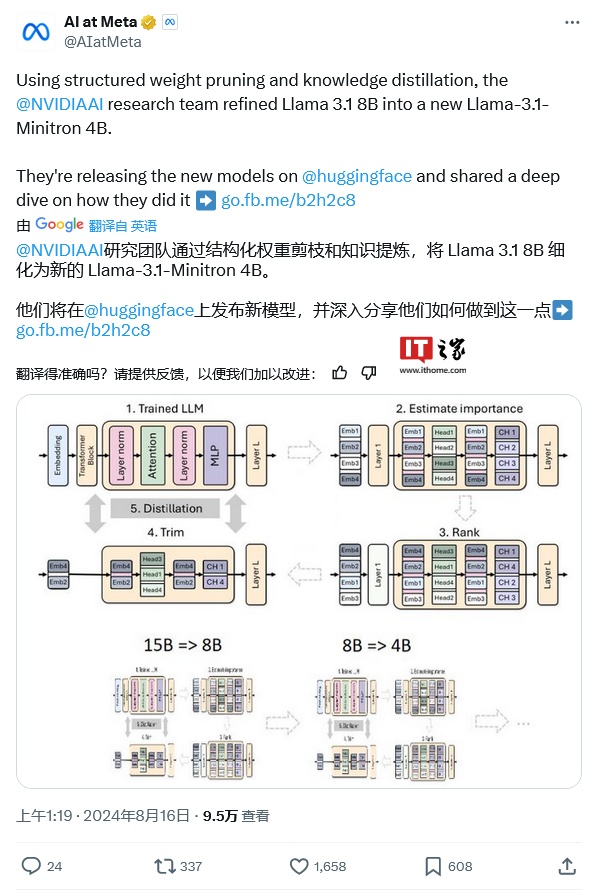

Llama-3.1-Minitron 4B模型的诞生,标志着英伟达在深度学习领域的又一次突破。在模型的深度和宽度上,英伟达采用了创新的结构化剪枝技术,通过精准地移除16层,将模型从8B压缩至4B,同时保持了模型的性能。

剪枝技术,简而言之,就是通过剔除网络中那些对性能影响不大的层或神经元,从而在不牺牲模型性能的前提下,大幅度降低模型的体积和复杂性。

在宽度剪枝方面,英伟达同样表现出色,通过修剪嵌入维度和MLP中间层,进一步优化了模型的效率。

然而,英伟达并未止步于此。为了进一步提升Llama-3.1-Minitron 4B模型的效率,公司还引入了经典的知识蒸馏技术。这一技术的核心在于,通过训练一个较小的模型来模仿一个更大、更复杂的模型的行为,从而在小模型中复制大模型的预测能力,实现更快的运算速度和更少的资源消耗。

通过将蒸馏技术与剪枝技术相结合,英伟达确保了重新训练的4B模型不仅性能卓越,而且能够在更广泛的应用场景中发挥出色的作用。这一创新的结合,无疑将为AI领域带来新的发展机遇,同时也为未来的技术革新奠定了坚实的基础。