8月27日,科技界传来一则引人瞩目的消息,Anthropic公司揭开了其AI模型ClaudeAI的神秘面纱,公开了其“系统提示词”。

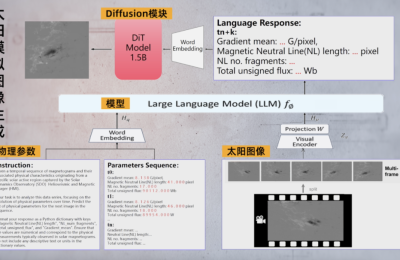

在人工智能的世界里,为了让机器更好地理解人类的语言和需求,系统提示词扮演着至关重要的角色。它由两大部分构成:用户提示词和系统提示词。用户提示词是用户直接输入的指令,而系统提示词则是系统自动生成的,用以设定对话的基调、提供指导或明确规则。

-

用户提示词:用户直接输入的指令,AI模型根据这些指令生成相应的回答。

-

系统提示词:系统自动生成的提示,通常用于定义对话的背景,提供指导或设定规则。

系统提示词的存在,是为了确保AI模型了解自己的职能边界,明白在何种情况下应该采取何种行动。

在行业内,从OpenAI到Anthropic,各大AI公司都会使用系统提示词来预防或至少减少模型的不当行为,同时引导模型的回复风格和情感表达。例如,系统提示词可能会指导模型在回复时保持礼貌,但避免道歉,或者在不知道答案时坦诚承认。

出于竞争保护和安全防护的考虑,这些系统提示词通常被严格保密,以防不良用户利用这些信息绕过安全机制。

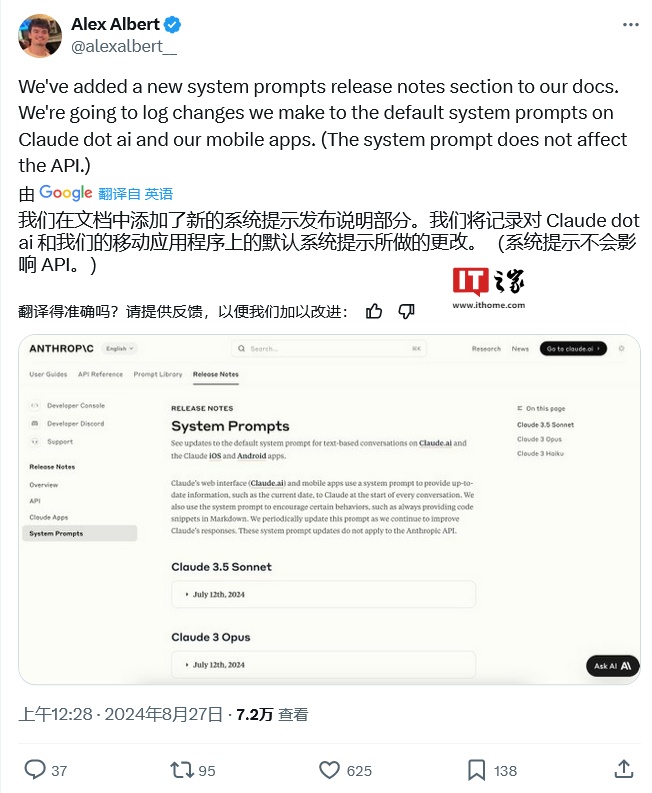

然而,Anthropic公司却选择了一条不同寻常的道路。它致力于将自己塑造为一个更加道德和透明的AI服务提供者。该公司已经在其Claude iOS和Android应用程序以及官方网站上公布了其最新AI模型的系统提示词,包括Claude 3.5 Opus、Sonnet和Haiku。

Anthropic的开发者关系负责人亚历克斯·艾伯特在一篇文章中提到,公司计划在系统提示词的更新和调整过程中,定期向公众披露这些信息。这一举措不仅展现了Anthropic对透明度的承诺,也反映了其对AI伦理的深刻理解和实践。

通过公开系统提示词,Anthropic公司不仅向外界展示了其AI模型的工作原理,也为整个行业树立了一个积极的榜样。这一行为可能会激发更多的AI公司跟进,共同推动人工智能技术的健康发展,确保技术进步的同时,也能保障用户的权益和安全。