在今日的科技前沿,中国科学院微电子研究所的研究人员们带来了一项激动人心的突破。他们成功地将人工神经网络与人类大脑的动态可塑性相结合,研发出了一种全新的基于语义记忆的动态神经网络技术。

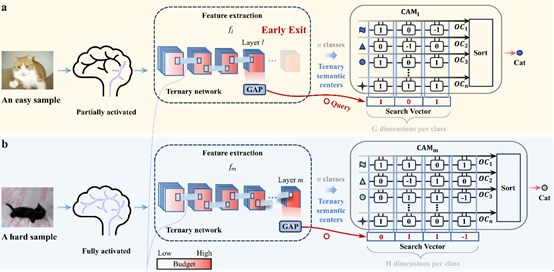

众所周知,人类的大脑神经网络拥有令人惊叹的语义记忆能力和动态连接性,这使得大脑能够将瞬息万变的信息与我们丰富的记忆库相联系,从而高效地处理各种复杂任务。

然而,目前人工智能领域广泛采用的神经网络模型大多还停留在静态阶段。随着数据量的爆炸式增长,这些静态模型在传统的数字计算系统中不仅消耗了大量的能源,还耗费了大量的时间,难以适应快速变化的外部环境。

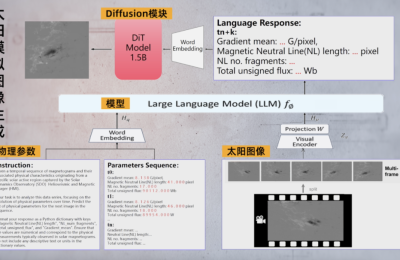

相比之下,这种新型的语义记忆动态神经网络展现出了其独特的优势。它能够根据可用的计算资源,灵活地在识别准确性和计算效率之间做出权衡,这使得它在资源受限的设备或分布式计算环境中能够发挥出卓越的性能。

据最新研究结果显示,在对2D图像数据集MNIST和3D点云数据集ModelNet进行分类任务时,这种新型神经网络的设计不仅达到了与传统软件相媲美的准确率,而且在计算量上分别比静态神经网络减少了48.1%和15.9%,与传统数字硬件系统相比,更是显著降低了计算能耗。

这一创新成果不仅为人工智能的发展开辟了新的道路,也为未来的技术进步提供了无限的可能性。随着这项技术的不断成熟和应用,我们有理由相信,它将为人工智能领域带来一场革命性的变革。