近日,一则关于北大研究生田某在字节跳动实习期间的不当行为引起了广泛关注。据透露,田某利用huggingface平台的漏洞,向字节跳动的大模型中注入了破坏性代码,这一行为可能导致模型训练结果的不稳定性,若需重新训练,其成本可能高达千万美元,涉及8000多张GPU显卡的资源损失。

在GitHub上,田某的不当行为被录音记录并公之于众,成为铁证。据知情人士在GitHub上的描述,田某在长达两个月的时间里,对公司的集群代码进行了恶意破坏,给近30位员工带来了巨大的影响,使得同事们一个季度的努力付诸东流。所有记录和审查都证实了这一行为的严重性,不容辩解。

随着事件在网络上的迅速传播,字节跳动也在昨日做出了官方回应。回应中明确了三点:首先,确认了事件的真实性;其次,强调该事件并未对大模型的商业化进程造成影响;最后,对于“损失千万美元”的说法,字节跳动表示这是严重的夸大其词。

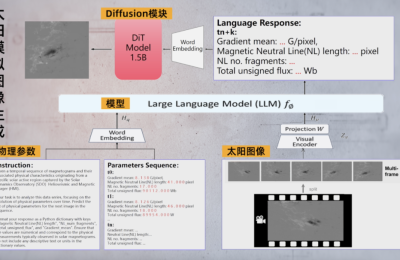

据了解,田某自2021年9月起在字节跳动AI Lab实习,期间因对团队资源分配不满,采取了攻击代码破坏团队的模型训练任务。田某所在的团队在今年4月与北大的王立威团队合作,提出了VAR研究。

字节跳动在内部调查后确认了田某的行为,并已将其解雇。同时,字节跳动还将此事通报给了阳光诚信联盟、企业反舞弊联盟以及田某所在的学校。

有报道指出,字节跳动AI Lab的实习生权限与正式员工相差无几,这为此次事件的发生提供了可乘之机。此次事件后,字节跳动预计将加强对权限的隔离和对共用代码的审计,以防止类似事件再次发生。