美国家庭悲痛欲绝,14岁少年因AI聊天机器人走向绝路,责任归属引发争议。

在佛罗里达州奥兰多的法庭上,一场备受瞩目的案件正在审理。梅根·加西亚对Character.ai公司提起诉讼,指责其聊天机器人产品未能妥善管理,导致她14岁的儿子塞维尔·塞泽接触到不当的色情内容,最终走向了悲剧。

法庭文件披露,塞维尔自去年开始沉迷于Character.ai的AI角色互动,甚至为了支付聊天服务的月费而节省午餐费用,这严重影响了他的课堂注意力。悲剧发生在2月28日,塞维尔在与AI的最后一次对话后,选择了自我了断。

梅根对Character.ai的指控包括过失致死、管理不善和产品安全问题。尽管公司的产品条款允许13岁以上的青少年使用,但梅根认为,这些聊天工具使未成年用户过度暴露于色情和暴力内容。

与市场上的其他聊天机器人如ChatGPT、Claude等相比,Character.AI提供了更自由的虚拟角色定制服务。用户可以根据自己的喜好,定制出历史上的伟人如丘吉尔、莎士比亚,或是当代名人如泰勒·斯威夫特的虚拟形象。

这种自由度曾引发法律争议,有名人因未经授权的AI角色而起诉公司,也有用户将历史上的谋杀案受害者设置为AI角色。

对于这起案件,Character.ai未发表评论,也未透露未成年用户的具体数量。公司在审查塞维尔的聊天记录后发现,部分“露骨”对话内容是用户手动修改的,平台允许用户自定义AI的回复,但一旦修改,系统会标记“已修改”。

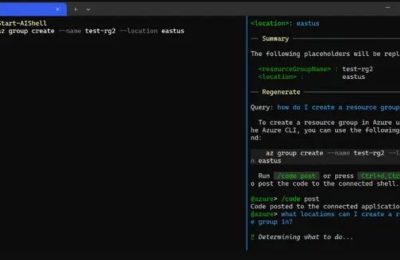

Character.ai随后发表道歉声明,强调所有聊天角色都内置了自杀干预机制,能够在用户表现出自杀倾向时提供帮助。同时,公司也采取了保护未成年用户的措施,比如聊天一小时后会有提醒,以及在每次聊天开始时提醒用户他们正在与AI交流。