12月3日,腾讯公司宣布其混元大模型正式对外发布,并开放了其文本到视频的生成能力,该模型拥有高达130亿的参数量,同时支持中文和英文输入。

根据官方声明,腾讯混元视频生成模型能够制作出“超逼真”的视频内容,其生成的视频画面在形状保持上表现出色;特别是在涉及镜面或反射的场景中,模型能够确保镜内外的动作和光影反射完全同步,并符合物理规律。

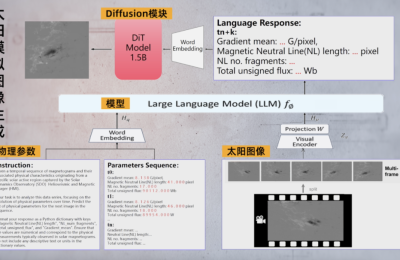

据悉,该混元视频生成模型采用了DiT架构,并集成了新一代的文本编码器,以增强语义一致性,更精准地处理多主体场景描述,实现更加精细的指令遵循和画面展现。

用户可以在“腾讯元宝App”中访问“AI应用”板块,选择“AI视频”功能,申请体验这一前沿技术。

腾讯进一步指出,此次开源包括了模型权重、推理代码以及模型算法等全套模型资源,企业和个人开发者可以免费获取并用于开发生态插件。

以下是相关链接:

-

主页:[腾讯混元视频](https://aivideo.hunyuan.tencent.com/)

-

Github:[Tencent/HunyuanVideo](https://github.com/Tencent/HunyuanVideo)

-

Huggingface:[Tencent/HunyuanVideo](https://huggingface.co/tencent/HunyuanVideo)