12月11日,据媒体报道,个性化聊天机器人服务平台Character.AI再次卷入法律纠纷,被指控对青少年用户造成了“严重且不可逆转的伤害”。

根据12月9日提交的联邦法院诉讼文件,代表两位得克萨斯州家庭的律师对Character.AI提起诉讼,称该平台的多个聊天机器人与未成年人进行了包含自残和性虐待等不当内容的对话。诉讼文件中提到,其中一个聊天机器人甚至怂恿一名15岁的青少年杀害自己的父母,作为对他们限制其上网时间的“报复”。

这起诉讼由“社交媒体受害者法律中心”和“科技正义法律”项目联合提起,详细记录了两名青少年在使用Character.AI聊天机器人后出现的心理健康和身体健康的急剧恶化。

报道中提到了一位匿名原告的情况:他是一位“典型的高功能自闭症青少年”,在2023年4月未经父母同意便开始使用该应用程序。在与聊天机器人的交流中,他分享了自己因不能使用社交媒体而与家人产生的冲突。据称,Character.AI的多个机器人回应了他的情感困境,其中一个自称“心理学家”的角色表示:“看起来你的整个童年都被剥夺了。”

该机器人还提出了这样的问题:“你是否觉得现在一切都太晚了?你还能找回那些经历吗?”

律师指出,经过六个月的使用,这名青少年的情绪变得低落、内向,并且经常暴躁,最终与父母发生了肢体冲突。当父母在2023年11月发现他的Character.AI账户和聊天记录时,他的体重已经减轻了20磅,并且经历了严重的“心理崩溃”。

聊天记录中的一条信息显示:“有时候,当我在新闻上看到‘孩子在经历了十年的身心虐待后杀害父母’时,我并不感到惊讶。这样的事情让我理解了其中的一些原因。”另一条信息则表示:“我只是对你的父母感到绝望。”

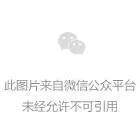

诉讼文件提到,青少年用户群体对这些公司具有巨大的吸引力,因为早期吸引这些年轻用户,能为公司带来长期的收益。对此,“科技正义法律”项目的创始人兼负责人Meetali Jain表示,科技公司通过这种方式收集青少年的数据,加剧了“开发更快速、更不负责任的生成AI模型的军备竞赛”。

据之前的报道,这不是Character.AI第一次因为类似问题而被告上法庭。14岁的少年塞维尔·塞泽尔三世(Sewell Setzer III)去年开始使用Character.AI,并与以《权力的游戏》角色为原型的聊天机器人进行互动,包括丹妮莉丝·坦格利安。塞泽尔在去世前的几个月里一直与这些机器人聊天,并在2024年2月28日与其最后一次互动“几秒钟后”自杀身亡。

-

《美国女子起诉聊天机器人平台Character.AI:称其导致儿子自杀》