12月14日,360智脑官方公众号披露重磅消息,360公司推出了自主研发的AI大模型——360gpt2-o1,该模型在推理能力上实现了质的飞跃,特别是在数学和逻辑推理领域展现出卓越的性能。

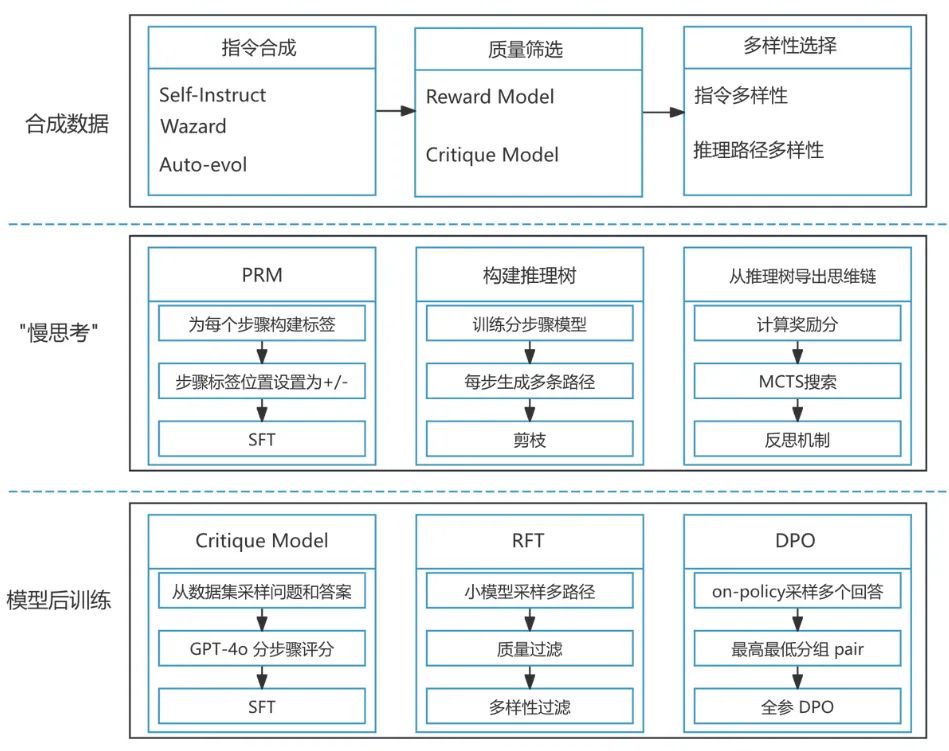

360gpt2-o1之所以能够取得技术突破,得益于其在合成数据优化、模型后训练以及“慢思考”范式上的创新。这些技术的应用使得该模型在多个权威评测中获得了令人瞩目的成绩。

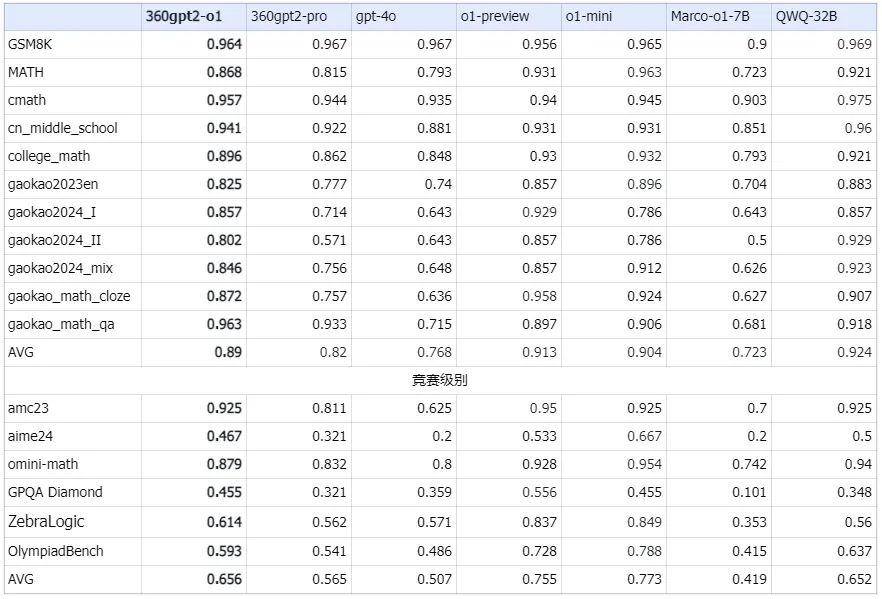

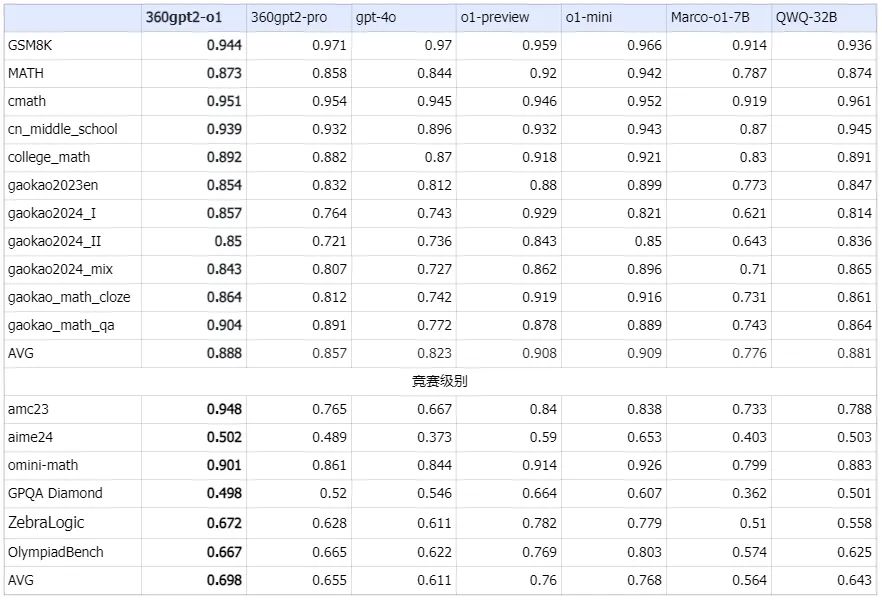

在基础数学评测和权威数学竞赛中,360gpt2-o1不仅超越了其前身360gpt2-pro,甚至在某些方面超越了GPT-4o模型。具体来说,在MATH、高考数学等基础数学评测,以及AIME24、AMC23等权威数学竞赛中,360gpt2-o1均取得了显著的成绩。

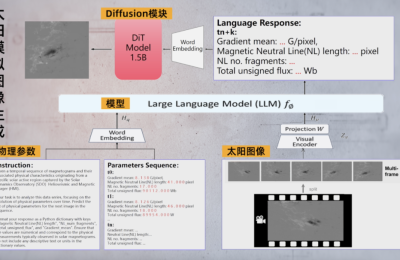

在数学竞赛评测中,360gpt2-o1的表现尤为突出,甚至超过了阿里巴巴最新开源的o1系列模型QWQ-32B-preview。以下是该模型的整体架构概览:

优化合成数据

360gpt2-o1通过指令合成和质量/多样性筛选等手段,有效解决了高质量数学与逻辑推理数据稀缺的问题,从而扩充了训练数据集,提高了模型的泛化能力。

模型后训练

该模型采用了创新的两阶段训练策略。首先,利用小模型生成多样化的推理路径;其次,通过RFT训练和强化学习训练,进一步提升了大模型的推理能力和自我纠错能力。

“慢思考”范式

360gpt2-o1通过蒙特卡洛树搜索探索出多样化的解决方案,并结合LLM进行错误验证和纠错,模拟了人类逐步推理和反思的过程。这一过程最终形成了一个包含反思、验证、纠错和回溯的长思维链,极大地提升了模型的逻辑推理能力。