最新研究揭示,像ChatGPT这样的大型语言模型(LLMs)在模仿人类大脑处理语言的神经机制方面取得了显著进展。12月20日,科技界传来消息,这些模型不仅在性能上有所增强,而且在结构上也越来越接近于人类大脑的复杂性。

Tech Xplore在18日的报道中提到,哥伦比亚大学和费因斯坦医学研究所的科研人员最近完成了一项开创性研究,旨在探索LLMs与大脑神经反应的相似之处。这项研究显示,随着LLMs技术的不断进步,它们在模拟人类大脑处理语言的方式上取得了实质性进展。

论文的主要作者加文·米施勒在接受Tech Xplore采访时分享了他们的研究动机:“我们的研究灵感来自于LLM和神经人工智能领域的快速发展。”

他进一步解释说:“早期的研究已经表明,GPT-2的词嵌入与人脑对语言的神经反应存在相似之处,但随着技术的飞速发展,GPT-2已经变得过时。”

“自从ChatGPT问世以来,出现了许多更先进的模型,但关于这些新模型是否仍然保持与大脑相似性的研究却相对匮乏。”

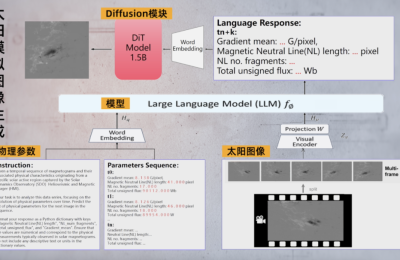

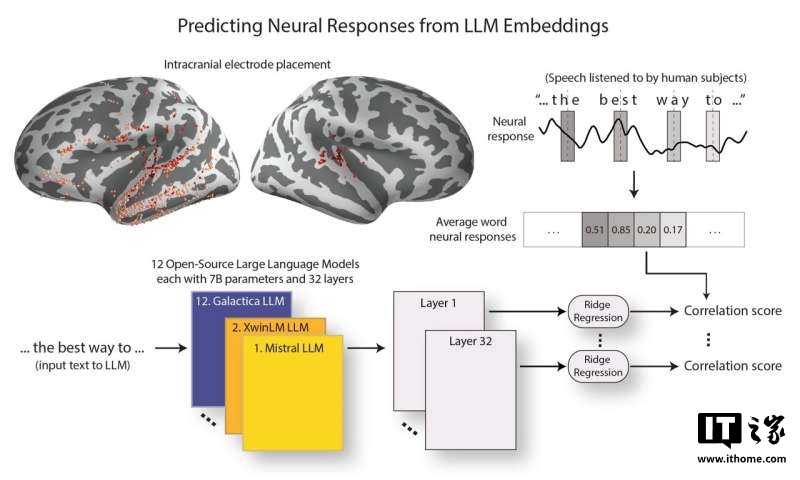

米施勒和他的团队致力于研究最新一代的LLMs是否仍然展现出与人类大脑相似的特征。他们分析了12个不同的开源LLMs,这些模型在架构和参数数量上几乎相同。同时,他们还通过在神经外科患者的大脑中植入电极来记录他们听到语言时的大脑反应。

米施勒解释了他们的研究方法:“我们将相同的语言材料输入LLMs,并提取它们的词嵌入,这些嵌入是模型内部用来处理和编码文本的表示。为了评估LLMs与大脑的相似性,我们尝试通过预测大脑对词语反应的神经活动来评估它们的对应性。通过这种方法,我们能够衡量两者的相似度。”

在收集了数据之后,研究人员使用计算工具来分析LLMs与大脑的对齐程度。他们特别关注LLMs的哪些层次与大脑中负责语言处理的区域最为匹配。已知大脑对语言的反应是通过逐步分析语音的声学、语音学等成分来建立语言的抽象表征。

米施勒指出:“我们发现,随着LLMs能力的增强,它们的词嵌入与大脑对语言的反应越来越接近。更令人惊讶的是,随着模型性能的提升,它们与大脑层次结构的对齐程度也有所提高。这表明,在语言处理过程中,大脑不同区域提取的信息与性能较强的LLMs的不同层次提取的信息更加一致。”

这些发现表明,性能最佳的LLMs能够更准确地反映大脑的语言处理反应。此外,这些模型的卓越表现可能与它们早期层次的高效性有关。

这项研究成果已经在《自然・机器智能》期刊上发表,感兴趣的读者可以通过以下链接访问全文:[点击此处]。