(本文为原创内容,转载需注明出处)

字节跳动在AI大模型领域再次掀起波澜!

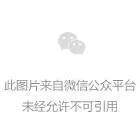

12月18日,字节跳动在火山引擎Force大会上隆重推出了豆包视觉理解模型,旨在为企业提供更经济高效的多模态大模型解决方案。

据大会公布的数据显示,豆包视觉理解模型的千tokens输入成本仅为3厘钱,仅需一元即可处理284张720P图片,相较于行业标准价格低出85%,这无疑将推动AI技术的普及和应用发展。

同日,OpenAI也宣布加入降价行列。

其正式版o1模型的API成本相较于预览版下降了60%,GPT-4o的音频成本同样降低了60%,而GPT-4o mini的音频价格更是当前价格的十分之一。

这一系列动作表明,大模型行业的竞争已经进入了价格战的新阶段。随着各大厂商的降价策略,大模型的定价模式正从“分”时代向“厘”时代转变。

AI大模型,价格战愈演愈烈

自今年中期以来,AI大模型领域的价格战愈发激烈。在AI大模型的热潮中,竞争焦点已从单纯的技术竞争扩展到了价格和具体的应用场景。

5月中旬,字节跳动率先发布豆包大模型,以0.0008元/千tokens的定价引领价格战,声称比行业价格低99.3%。

紧接着,阿里云宣布旗下9款主力AI大模型全面降价,其中Qwen—Long API的输入价格从0.02元/千tokens降至0.0005元/千tokens,降幅高达97%。

腾讯也宣布下调大模型价格,其混元-lite模型价格从0.008元/千tokens调整为免费,API输入输出总长度也计划从4k提升至256k。

7月,百度宣布文心旗舰款模型ERNIE 4.0和ERNIE 3.5大幅降价,ERNIE Speed、ERNIE Lite两款主力模型持续免费。

文心最新旗舰版大模型ERNIE 4.0 Turbo面向企业客户全面开放,其价格极具竞争力,输入输出价格分别降至0.03元/千Tokens、0.06元/千Tokens。

海外市场同样上演着价格战。

5月,OpenAI在春季发布会上推出了新一代旗舰AI模型“GPT-4o”,不仅功能上超越了GPT-4 Turbo,价格上也颇具吸引力。据官方介绍,新模型GPT-4o用户无需注册,功能全部免费。

此前,Chat GPT的免费用户只能使用GPT-3.5。更新后,用户可以免费使用GPT-4o进行数据分析、图像分析、互联网搜索、访问应用商店等操作。

尽管行业被降价信息包围,仍有大模型厂商选择不降价。

百川智能CEO王小川表示,价格免费是优势,但并非竞争力。百川不会参与价格战,因为To B不是公司的主要商业模式,价格战的影响有限,公司将更多精力放在超级应用上。

创新工场董事长、零一万物CEO李开复谈及价格战时表示,零一万物目前不打算降低YI系列模型的API价格,并认为零一万物的性能、性价比已经很高,疯狂降价会导致双输。

“卷低价”背后的竞争逻辑变化

AI大模型以其烧钱著称,商业化之路仍在探索中,为何先掀起降价潮?

一方面,大模型市场竞争日益激烈。据统计,国产大模型数量已超过200个,企业将价格作为竞争的关键手段之一,通过降价提升市场竞争力和份额。

研究机构Canalys指出,随着多领域垂直大模型的集中爆发,国内头部厂商为稳固行业地位,必须通过低价打入市场,降低大模型门槛以“跑马圈地”的方式尽快形成生态。

大模型降价的效果显著。以阿里云为例,降价后阿里云百炼平台的付费客户数比上一季度增长超过200%,更多企业选择在百炼上调用各类AI大模型。

另一方面,大模型的商业化应用需要大量用户和数据支撑,庞大的访问量有助于企业提升模型服务能力,并通过规模效应进一步降低成本。

华龙证券研报指出,随着国内外大模型厂商竞争加剧,开启价格战的信号非常明显。

通过降低价格门槛,大模型厂商有望吸引更广泛的企业用户群体,进一步平衡收入和成本。同时,更多C端用户有望免费使用基础AI应用,庞大的访问量有助于企业提升模型服务能力,完成良性循环。

各大模型厂商纷纷“卷”向价格只是序幕,接下来,各头部厂商将持续围绕如何加快大模型落地展开竞争,在竞争中推动大模型进入新的发展阶段。