在人工智能视频生成领域,Meta 近日带来了一项重大突破——VideoJAM。这一创新技术在运动连贯性方面取得了显著进展,甚至超越了当前备受瞩目的 OpenAI 的 Sora 模型。长期以来,AI 视频生成一直面临着一个棘手问题:虽然在视觉外观上能够做到较为逼真,但在运动的真实性和连贯性方面却常常不尽如人意。这是因为以往的视频模型更多地关注静态画面的呈现,而忽略了动态过程中的复杂性。

VideoJAM 是由 Meta 与特拉维夫大学的研究人员共同开发的成果,它通过一种全新的框架来攻克视频生成中的运动生成难题。这一框架无需额外的数据支持或扩大模型规模,便能有效提升视频中运动的表现力。研究结果显示,VideoJAM 生成的视频在体操图灵测试中表现出色,其运动的真实性和连贯性明显优于 Sora。

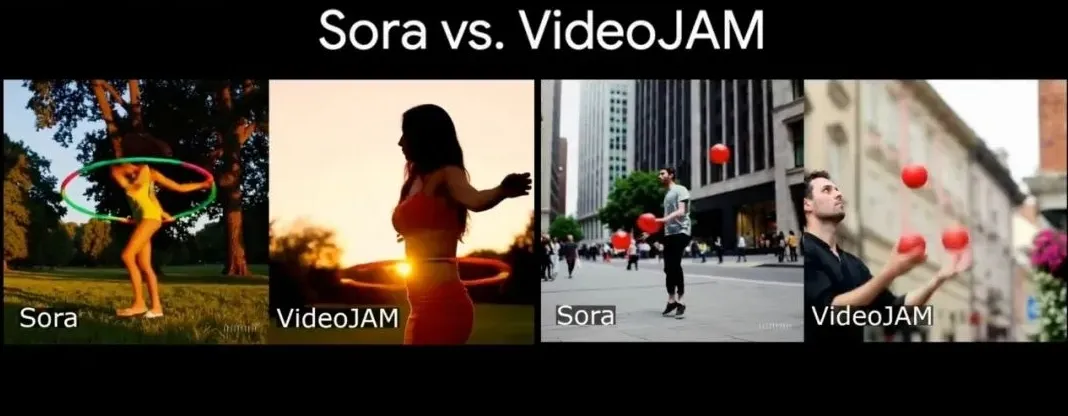

VideoJAM 与 Sora 的运动生成对比

从实际的对比案例中可以清晰地看到两者之间的差异。在生成体操动作时,Sora 的动作显得僵硬且不自然,仿佛是一个个生硬的姿势拼凑而成。而 VideoJAM 则能够生成流畅且符合人体力学的动作,每一个动作的过渡都显得自然流畅。在男子抛球的视频生成中,Sora 的效果让人忍俊不禁,抛球动作显得滑稽可笑,完全不符合物理规律。而 VideoJAM 生成的视频则真实自然,抛球的动作和轨迹都符合现实中的物理现象。对于转呼啦圈这类需要精准理解运动原理的动作,Sora 生成的视频效果差强人意,无法准确模拟出转呼啦圈的动态过程。而 VideoJAM 则能够精准地模拟出这一动作,让观众感受到动作的真实性和自然性。

AI 视频生成面临的运动捕捉挑战

AI 视频生成模型在处理运动时面临的挑战主要在于难以精准捕捉现实世界中复杂的运动、动态和物理现象。Meta 的研究团队在研究过程中发现,当视频帧被打乱时,基于像素的损失几乎没有明显变化,这表明传统的模型对时间不一致性并不敏感。换句话说,以往的像素重建目标导致模型过度关注外观的保真度,而忽略了运动的连贯性。这就像是一个人在画画时,只注重画面上的颜色和形状,却忽略了画面中物体的动态变化。

VideoJAM 的创新解决方案

VideoJAM 的核心创新之处在于通过修改目标函数来引入显式的运动先验,让模型能够从单一的学习表征中同时预测外观和运动。这种方法就像是给模型戴上了一副“运动眼镜”,让它在关注外观的同时,也能敏锐地捕捉到动态变化。VideoJAM 由两个互补的模块组成:训练阶段的目标扩展和推理阶段的 Inner-Guidance 机制。

训练阶段:联合预测外观与运动

在训练阶段,研究人员将目标扩展为基于单一的学习表征,同时预测生成的像素及其对应的运动。这就像是让模型在学习过程中不仅要看清楚画面中的物体是什么样子,还要理解这些物体是如何运动的。通过这种方式,模型能够学习到外观与运动的联合表征,从而更好地理解运动的本质。

推理阶段:Inner-Guidance 机制

在推理阶段,VideoJAM 引入了 Inner-Guidance 机制。这一机制利用模型自身不断演化的运动预测作为动态引导信号,引导生成连贯、逼真的动作。这就像是给模型配备了一个“运动导航仪”,让它在生成视频的过程中能够始终沿着正确的运动方向前进,从而生成更加真实自然的视频。

VideoJAM 框架的一大优势在于它几乎无需对现有的视频模型进行额外的改动,也无需修改训练数据或扩大模型规模,即可实现卓越的运动连贯性。在仅使用自身训练集中的 300 万个样本对预训练视频生成模型(DiT)进行微调后,VideoJAM 就能够实现令人惊叹的运动连贯性,甚至超越了 Sora 等专有模型。

复杂运动的真实呈现

VideoJAM-30B 在高难度提示下生成的结果充分展现了其在复杂运动类型生成方面的卓越能力。在滑板运动员跳跃的视频中,运动员与滑板在空中的动作协调一致,落地时滑板的轻微震动也清晰可见,效果极为真实。在手指按压粘液球的视频中,清晰地展现了手指与粘液球的粘连状态,生动地体现了粘液的粘性。在花样滑冰运动员跳跃的视频中,运动员在空中旋转协调,快速移动中生成的模糊效果也恰到好处。在山羊在旋转球上保持平衡的视频中,山羊努力保持平衡的动作符合物理法则,让人不禁为它的平衡能力点赞。在厨师切番茄的视频中,对手指处理没有明显瑕疵,切下的西红柿之间也有自然的差异。在男孩吹生日蛋糕上的蜡烛的视频中,模型能够准确理解吹气与蜡烛火苗之间的逻辑关系。在花瓶在古董店木地板上摔碎的视频中,对碎裂场景的细节处理也十分到位,让人仿佛听到了花瓶破碎的声音。

视频 AI 的大 PK

为了证明 VideoJAM 在运动连贯性方面的优势,研究人员进行了定性和定量实验,对比了 Runway Gen3、Sora、DiT 和 VideoJAM 的表现。

定性实验结果

定性评估涵盖了多种运动类型,展现了当前 AI 视频模型面临的挑战,如体操动作、需要物理理解的情境等。即使是简单的运动,如长颈鹿奔跑,也会出现问题,例如“反向运动”(Sora)或不自然的动作(DiT-30B)。更复杂的运动会导致视频静态不变或身体变形。相比之下,VideoJAM 能够生成连贯的运动。在转动的指尖陀螺的案例中,所有模型都无法正确地遵循物理学定律。在同等条件下,VideoJAM 生成的视频主体更大、明暗对比更强烈,运动姿势也更自然。

定量实验结果

定量评估采用自动指标和人工评估相结合的方式,评估外观质量、运动质量以及提示词一致性。

自动指标评估

使用 VBench 基准评估视频生成模型,指标包括逐帧画面质量、美学评分、主体一致性、运动量以及运动连贯性。通过这些自动指标的评估,VideoJAM 在各项指标上均表现出色,尤其是在运动连贯性方面,明显优于其他模型。

人工评估结果

人工评估遵循二选一强制选择(2AFC)协议,评估者根据画面质量、运动表现和文本对齐度选择更优者。在人工评估中,VideoJAM 也获得了较高的评价,评估者普遍认为其生成的视频在运动表现和画面质量上更具优势。

消融实验结果

所有的消融实验都显著降低了运动连贯性,这进一步证明了运动引导组件在引导模型生成时间上连贯的视频方面发挥着重要作用。在推理阶段移除光流预测的影响最大,这充分证明了联合输出结构对于确保合理运动的优势。

VideoJAM 的局限性

尽管 VideoJAM 在运动连贯性方面取得了显著进展,但它仍面临一些挑战。由于计算资源的限制,模型在远景场景下难以捕捉运动信息。此外,在模拟物理交互时,模型仍存在不足之处。这就像是一个人在观察远处的物体时,由于距离过远,无法清晰地看到物体的运动细节,或者在模拟一个复杂的物理现象时,由于对物理规律的理解不够深入,无法准确地呈现出来。

结论

VideoJAM 通过由单一的潜在表示同时捕捉外观与运动,显著提升了运动连贯性,甚至可与强大的专有模型竞争。这一成果为未来在视频模型中注入更复杂的现实世界先验提供了广阔的可能,为整体建模真实世界交互开辟了新的方向。随着技术的不断发展和改进,我们有理由相信,未来的 AI 视频生成将在运动的真实性和连贯性方面达到更高的水平,为人们带来更加逼真、自然的视觉体验。