随着人工智能技术的飞速发展,语音理解语言模型(SULMs)逐渐成为研究热点。如今,西北工业大学 ASLP 实验室推出了一款名为 OSUM 的开放语音理解模型,致力于在有限的学术资源条件下,探索语音理解模型的高效训练与应用,为学术研究和技术发展注入新的活力。

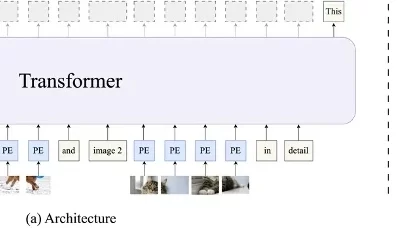

OSUM 模型巧妙地将 Whisper 编码器与 Qwen2 语言模型相结合,能够支持多达 8 种语音任务,涵盖语音识别(ASR)、带时间戳的语音识别(SRWT)、语音事件检测(VED)、语音情感识别(SER)、说话风格识别(SSR)、说话人性别分类(SGC)、说话人年龄预测(SAP)以及语音转文本聊天(STTC)。通过采用 ASR+X 的训练策略,OSUM 在执行目标任务的同时,能够高效且稳定地优化语音识别性能,显著提升了多任务学习的能力。

OSUM 模型的发布不仅仅关注性能的提升,更强调透明性。其训练方法和数据准备过程均已公开,为学术界提供了极具价值的参考和指导。根据最新发布的 OSUM 技术报告 v2.0,模型的训练数据量已从之前的 44.1K 小时大幅增加至 50.5K 小时,其中包括 3000 小时的语音性别分类数据和 6800 小时的说话人年龄预测数据。这些数据的扩充使得 OSUM 在各项任务中的表现更为出色。

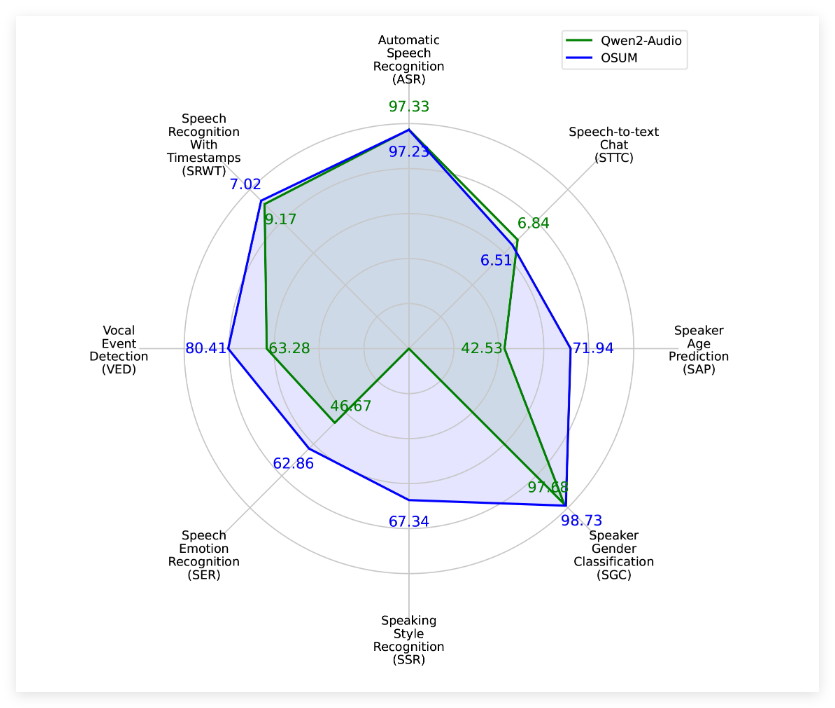

从评估结果来看,OSUM 在多项任务上的表现优于 Qwen2-Audio 模型,尽管其在计算资源和训练数据方面相对较少。评估涵盖了公共测试集和内部测试集,充分展示了 OSUM 在语音理解任务上的卓越性能。

西北工业大学 ASLP 实验室明确表示,OSUM 的核心目标是通过开放的研究平台,推动先进语音理解技术的发展。科研人员和开发者可以自由使用该模型的代码和权重,甚至可用于商业目的,从而加速技术的广泛应用和推广。

对于有兴趣深入了解 OSUM 项目的科研人员和开发者来说,可以通过以下链接访问项目主页:https://github.com/ASLP-lab/OSUM?tab=readme-ov-file

划重点:

🌟 OSUM 模型融合了 Whisper 编码器与 Qwen2 语言模型,支持多种语音任务,为多任务学习提供了强大支持。

📊 在技术报告 v2.0 中,OSUM 的训练数据量增至 50.5K 小时,显著提升了模型性能。

🆓 该模型的代码和权重在 Apache 2.0 许可下开放使用,鼓励学术界和工业界的广泛应用。